-

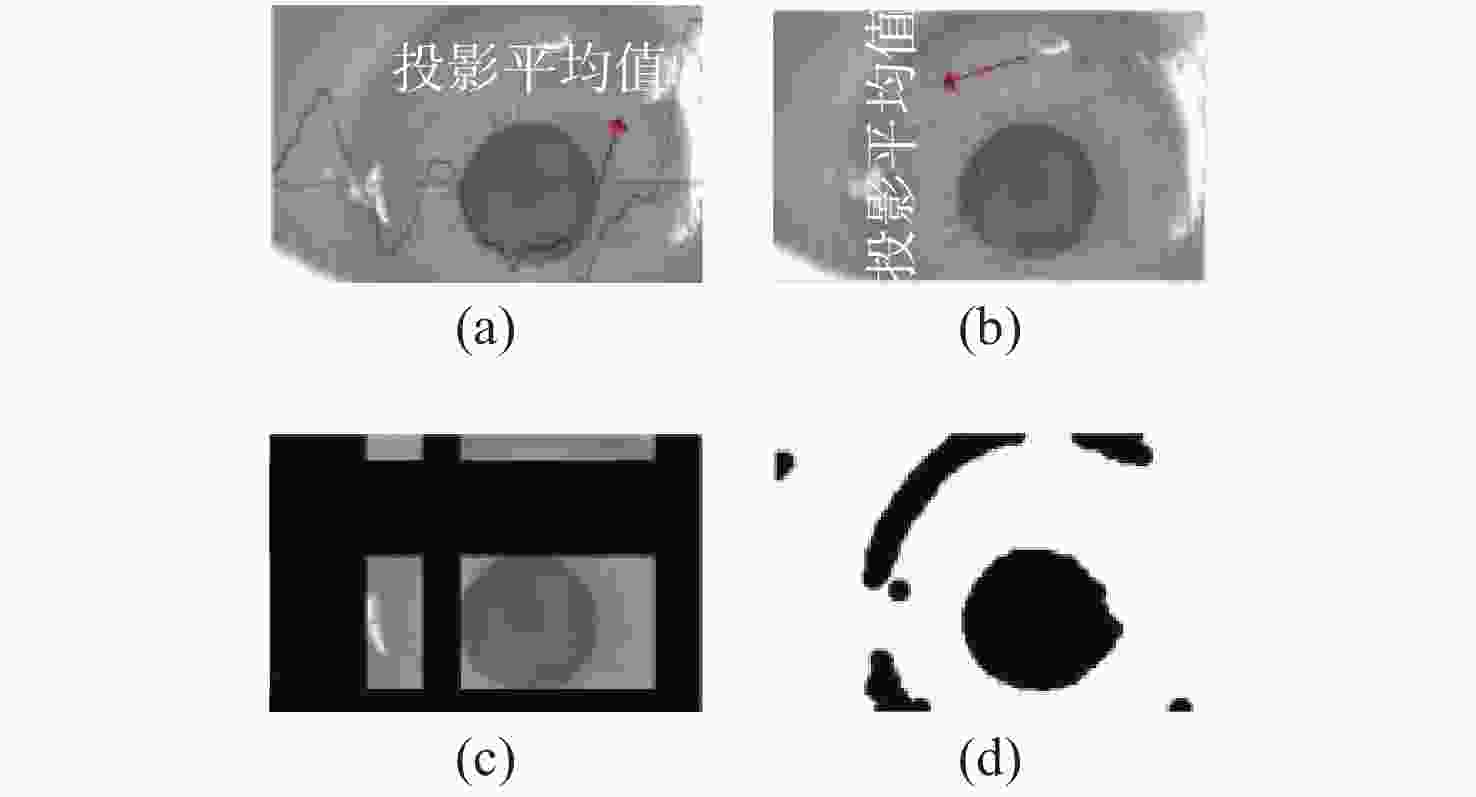

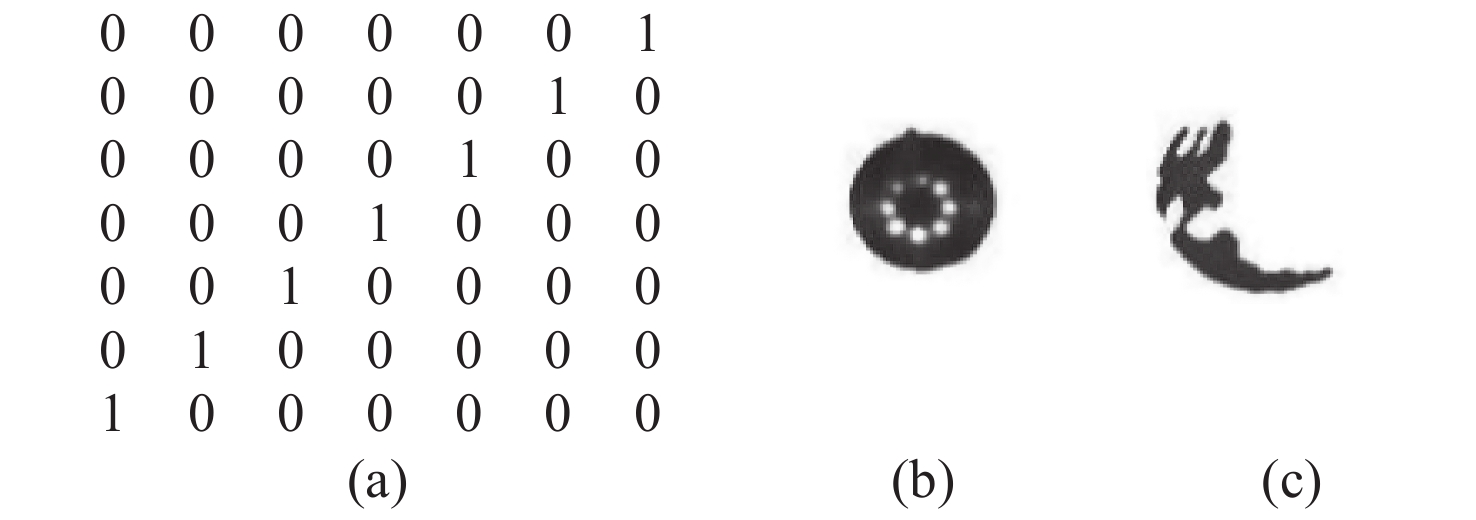

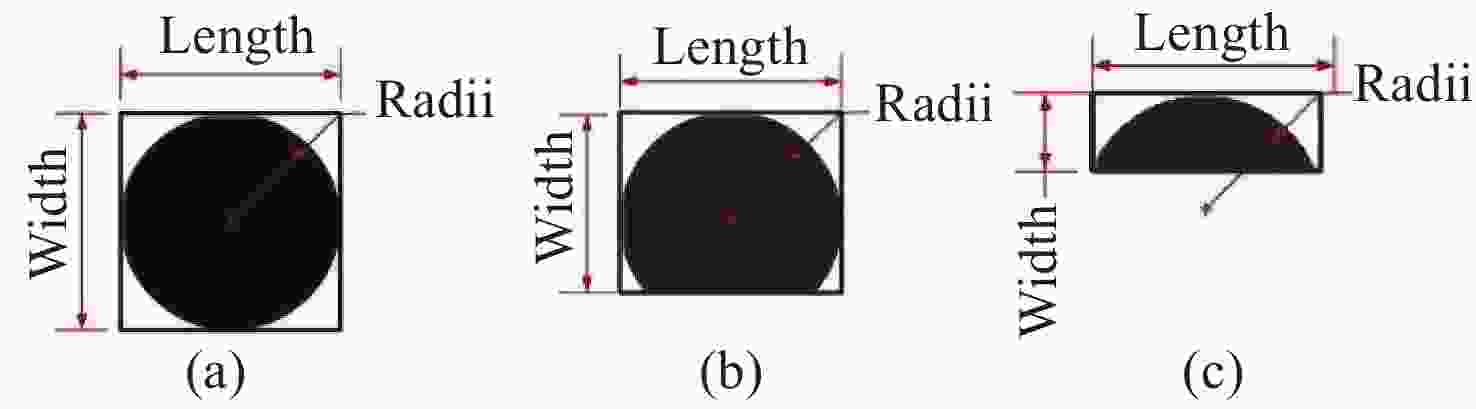

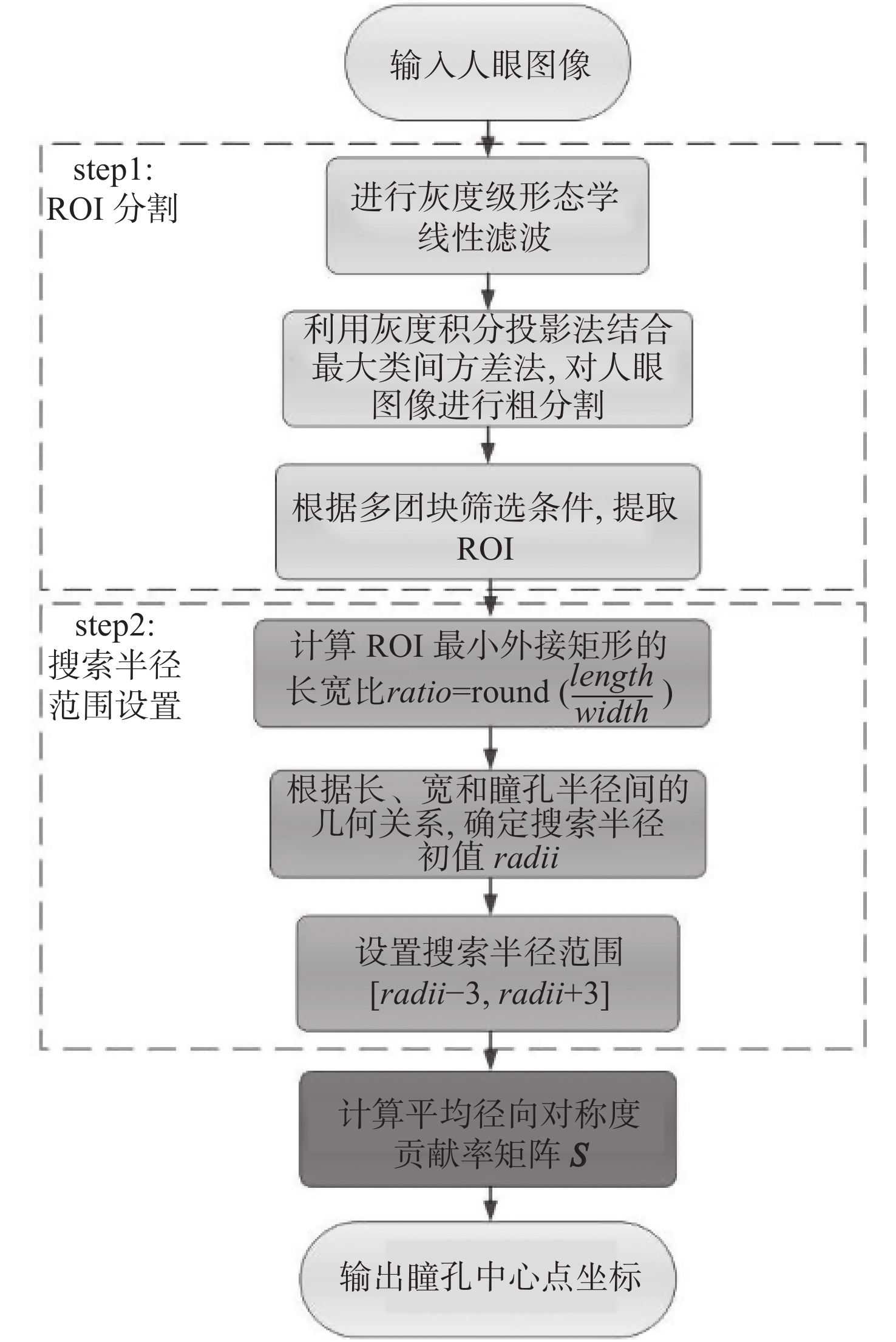

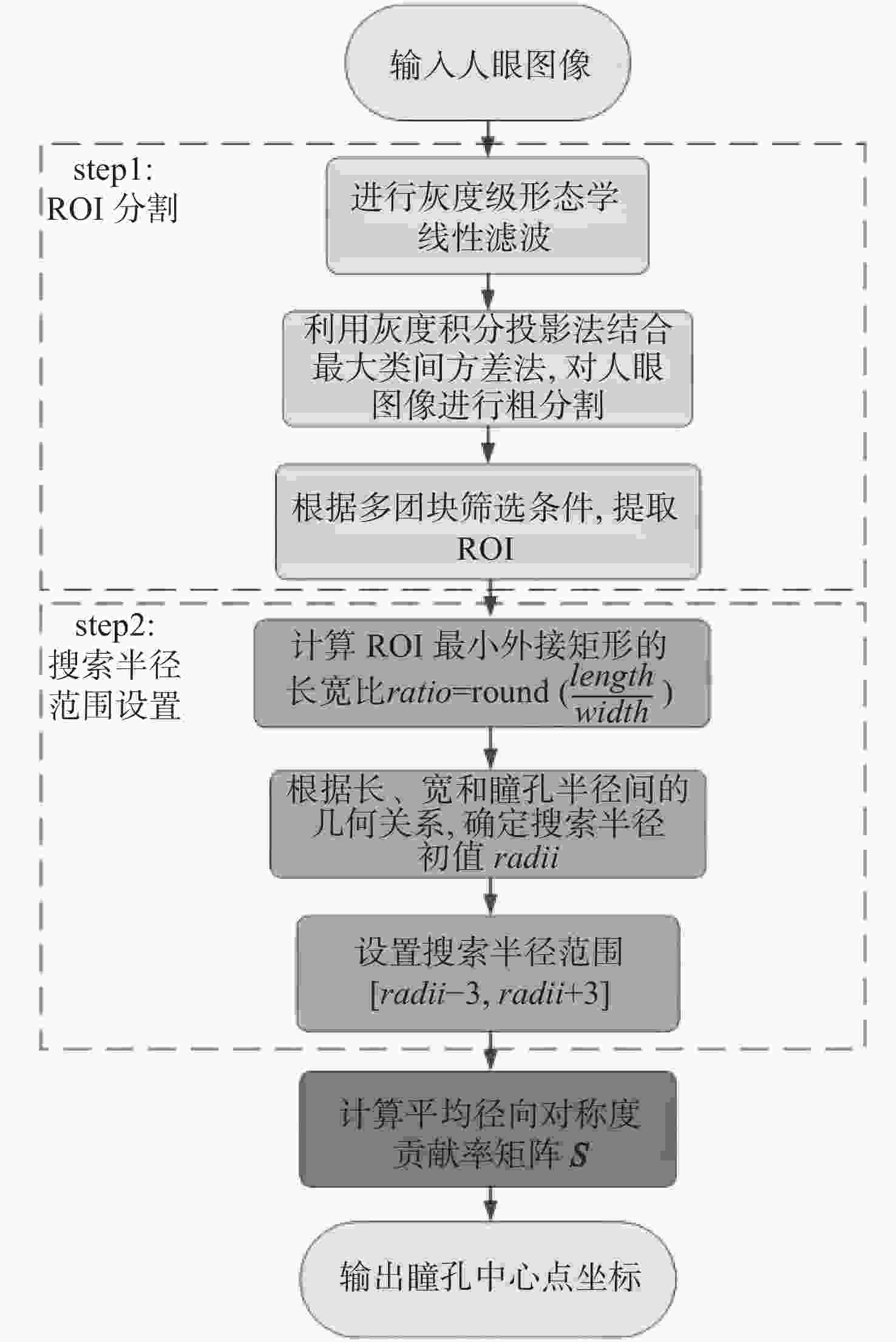

摘要: 在眼科疾病检测中,为了对被检测者进行快速、准确、自动化的瞳孔定位,提出一种改进径向对称变换的瞳孔中心点定位算法。首先利用灰度积分投影法结合最大类间方差法,完成对人眼图像的粗分割,并根据多团块筛选条件提取出只包含瞳孔的感兴趣区域(Region Of Interest,ROI)。然后对ROI采用最小外接矩形结合灰度级形态学线性滤波方法,完成搜索半径范围的设置。最后,利用改进的径向对称变换算法进行瞳孔中心点定位。实验结果表明:本文算法的定位误差在8 pixel以内,平均定位时间为0.366 s,能够适应人眼图像中噪声干扰、采集不完整等大量非理性状态,满足多种红外眼科疾病检测设备对瞳孔定位算法的要求。Abstract: In order to quickly, accurately and automatically locate a pupil in ophthalmic disease detection, a location algorithm for a pupil’s center based on radial symmetry transformation was proposed. Firstly, the gray integral projection method combined with the maximum class square error method was used to complete the rough segmentation of human eye image, and a Region Of Interest (ROI) solely containing the pupil was extracted according to multi-lump screening conditions. Then the search radius range was set by using a minimum circumscribed rectangle on the ROI combined with gray-level morphological linear filtering. Finally, the pupil center was located using an improved radial symmetry transformation algorithm. The experimental results show that the location error of this algorithm is less than 8 pixels and the average processing time is 0.366 s. It can adapt to a large number of irrational states such as noise interference and an incomplete collection of human eye images and meets the pupil location performance requirements for many kinds of infrared ophthalmology disease detection equipment.

-

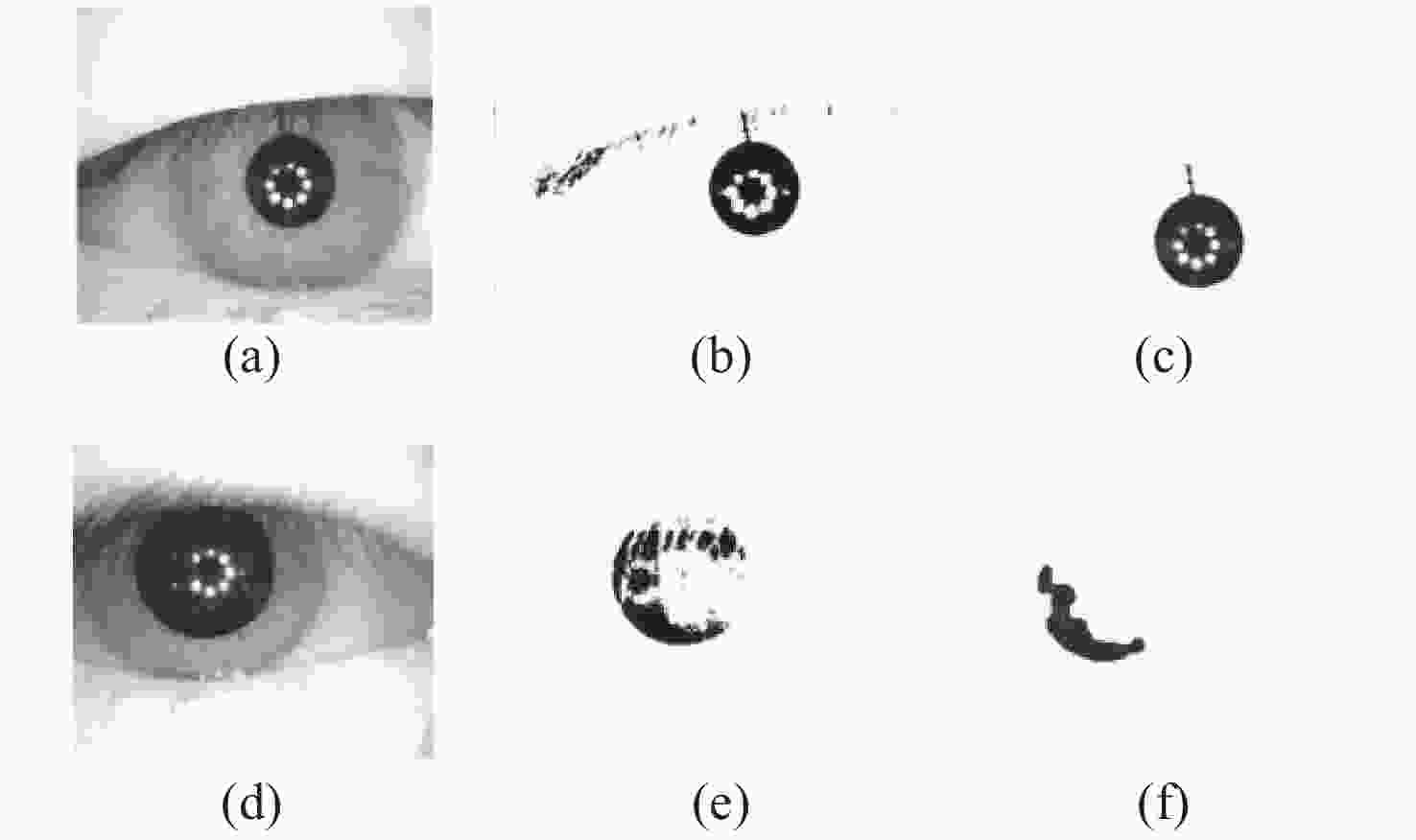

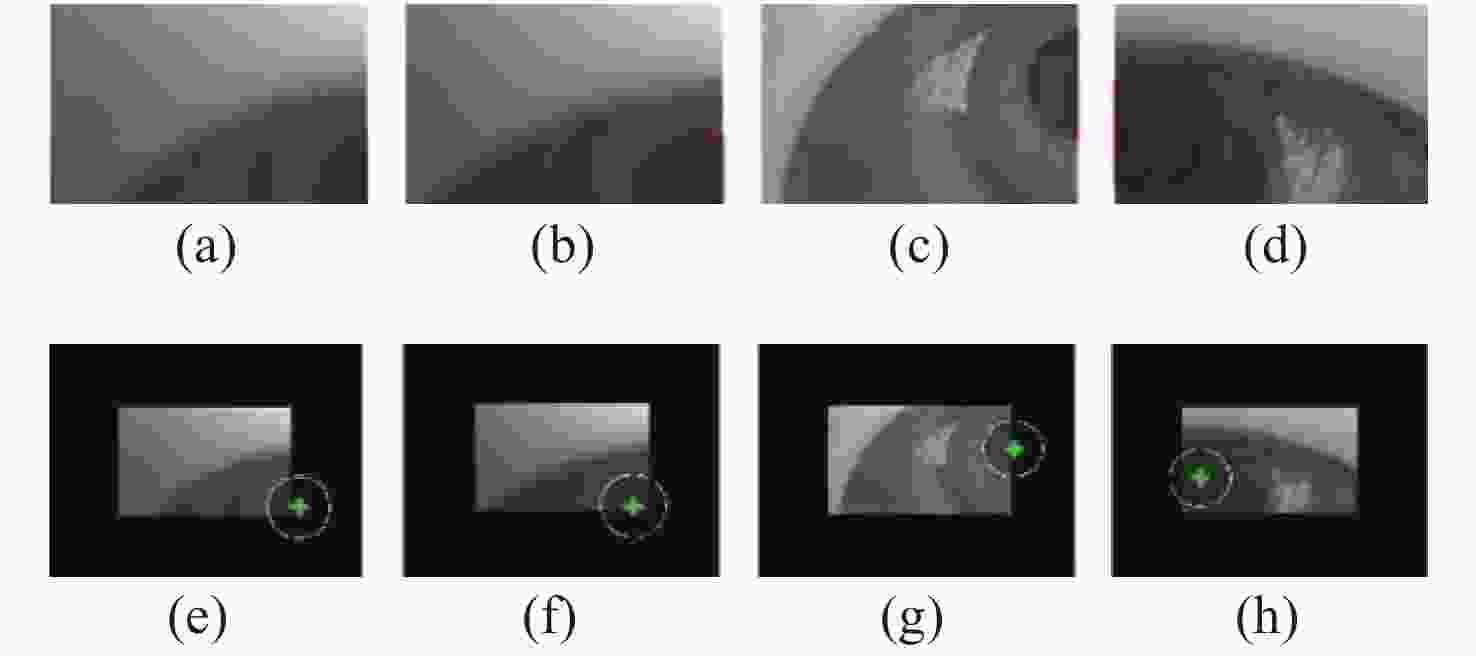

图 3 受睫毛遮挡的ROI提取示意图。(a)样本1图像;(b)样本1二值化图像;(c)样本1的ROI图像;(d)样本2图像;(e)样本2的二值化图像;(f)样本2的ROI图像,图像源于数据库CASIA-IrisV4

Figure 3. Schematic diagram of ROI extraction when pupil was obscured by eyelashes. (a) Image of sample 1; (b) binarization image of sample 1; (c) ROI image of the sample 1; (d) image of sample 2; (e) binarization image of sample 2; (f) ROI image of sample 2, images are derived from the CASIA-IrisV4 database

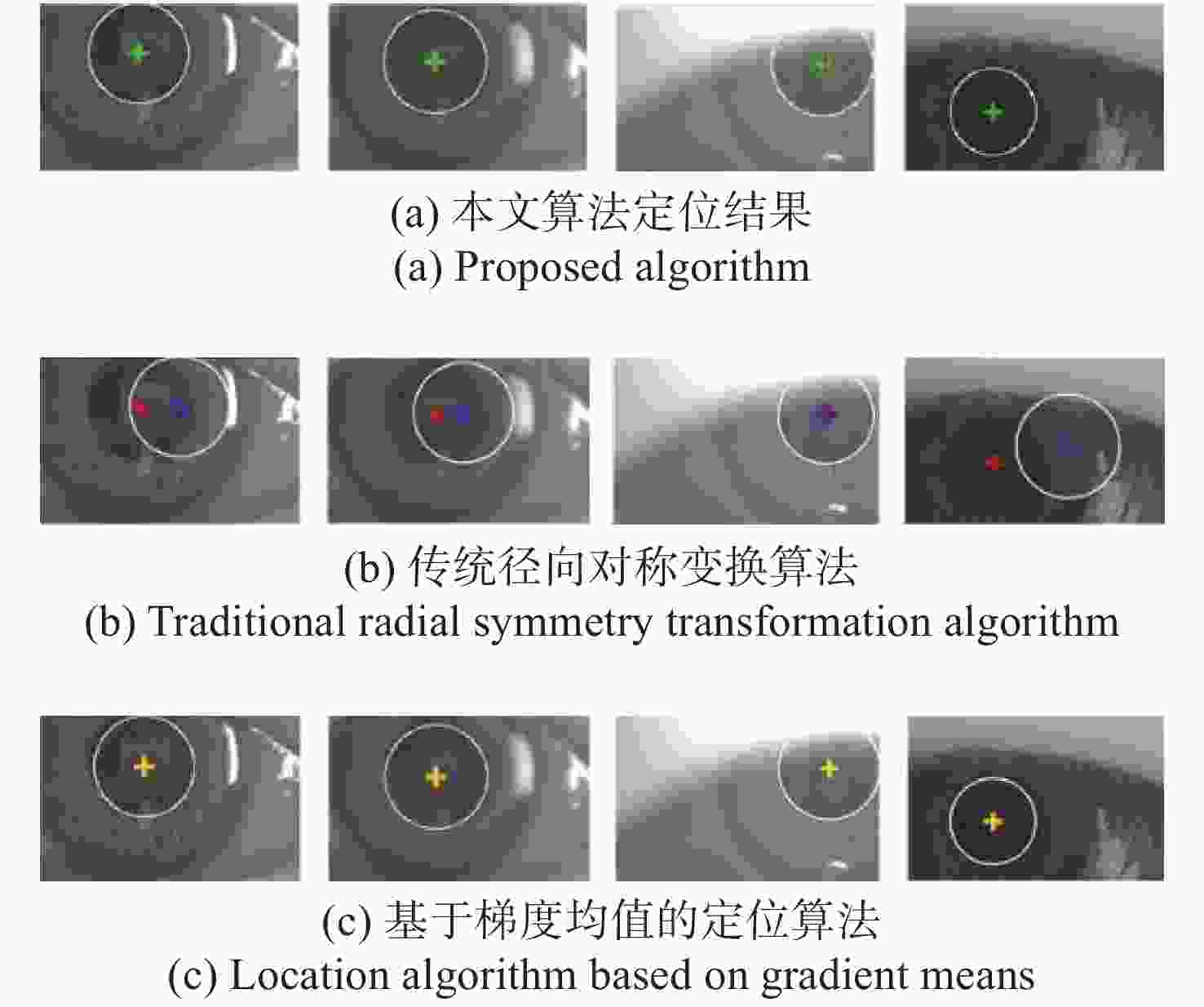

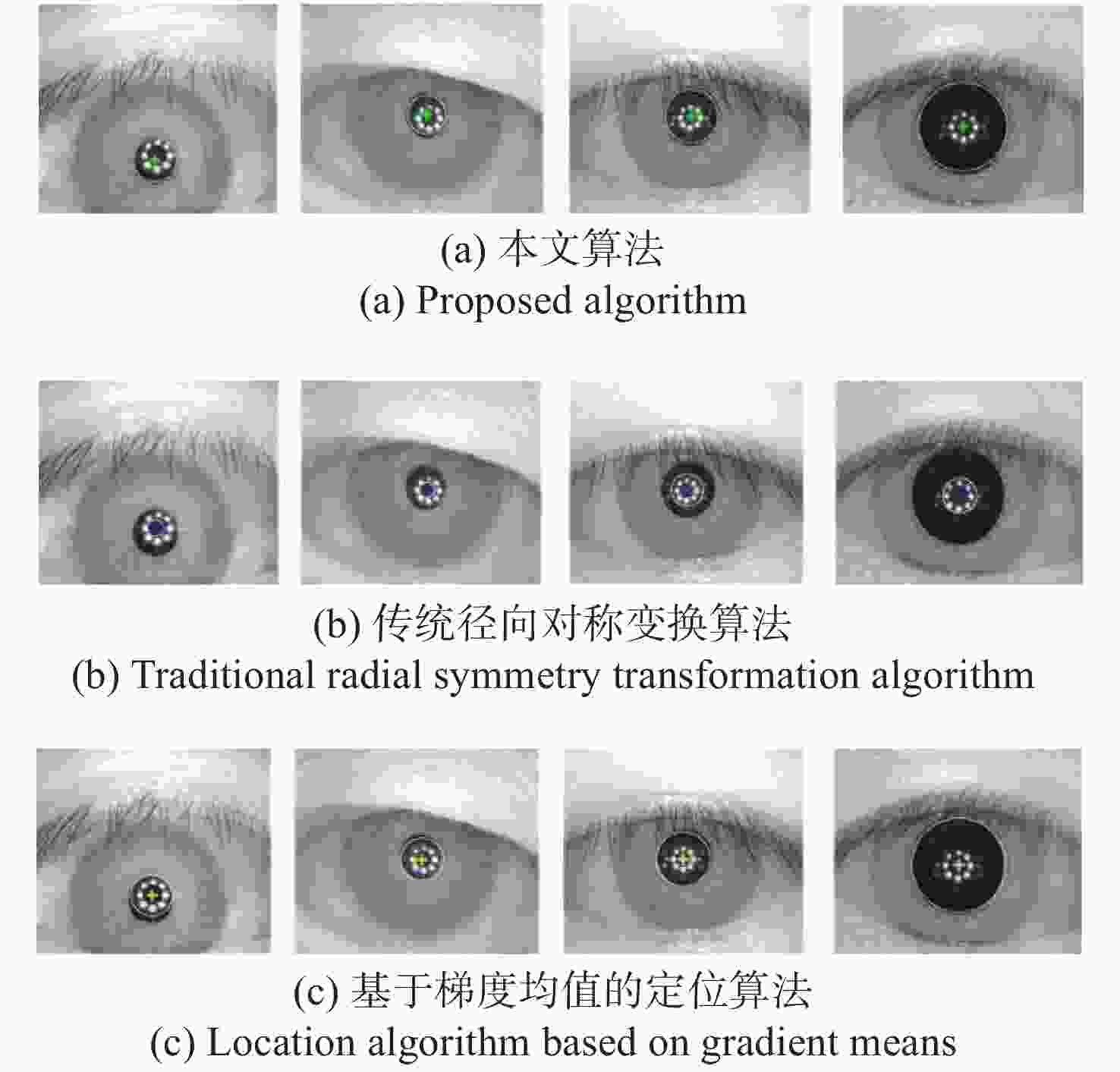

表 1 3种算法的精确度和实时性比较

Table 1. Comparison of accuracy and real-time performance of three algorithms

定位方法 定位误差/pixel 定位时间/s 本文算法 6.318 0.366 传统径向对称变换算法 103.681 4.610 基于梯度均值的定位算法 7.242 10.923 表 2 3种算法适用性比较

Table 2. Comparison of applicability of three algorithms

定位方法 定位准确率/% 定位时间/s 本文方法 98 0.053 传统径向对称变换算法 81 1.093 基于梯度均值的定位算法 93 8.583 -

[1] FLAXMAN S R, BOURNE R R A, RESNIKOFF S, et al. Global causes of blindness and distance vision impairment 1990-2020: a systematic review and meta-analysis[J]. The Lancet Global Health, 2017, 5(12): e1221-e1234. doi: 10.1016/S2214-109X(17)30393-5 [2] 蔡怀宇, 张玮茜, 韩晓艳, 等. 眼轴及眼前节SS-OCT一体化成像系统[J]. 红外与激光工程,2020,49(4):0413006. doi: 10.3788/IRLA202049.0413006CAI H Y, ZHANG W Q, HAN X Y, et al. Integrated imaging system of eye axis and anterior segment based on SS-OCT[J]. Infrared and Laser Engineering, 2020, 49(4): 0413006. (in Chinese) doi: 10.3788/IRLA202049.0413006 [3] 刘珊珊, 汪毅, 张玮茜, 等. 基于SS-OCT的大范围眼轴长度测量系统[J]. 光子学报,2019,48(5):512002. doi: 10.3788/gzxb20194805.0512002LIU SH SH, WANG Y, ZHANG W Q, et al. Large-scale axial length measuring system based on SS-OCT[J]. Acta Photonica Sinica, 2019, 48(5): 512002. (in Chinese) doi: 10.3788/gzxb20194805.0512002 [4] UZUN S, PEHLIVAN E. Evaluation of the macular choroidal thickness using spectral optical coherence tomography in pseudoexfoliation glaucoma[J]. Journal of Glaucoma, 2017, 26(3): e127-e128. [5] WANG SH Z, JIN K, LU H T, et al. Human visual system-based fundus image quality assessment of portable fundus camera photographs[J]. IEEE Transactions on Medical Imaging, 2016, 35(4): 1046-1055. doi: 10.1109/TMI.2015.2506902 [6] ZAPATA M A, ARCOS G, FONOLLOSA A, et al. Telemedicine for a general screening of retinal disease using nonmydriatic fundus cameras in optometry centers: three-year results[J]. Telemedicine Journal and E-Health:the Official Journal of the American Telemedicine Association, 2017, 23(1): 30-36. [7] 王晶, 高峰, 李婉越, 等. 瞳孔中心点自动定位与对准装置[J]. 光学 精密工程,2019,27(6):1370-1377. doi: 10.3788/OPE.20192706.1370WANG J, GAO F, LI W Y, et al. Device for automatic pupil center location and alignment[J]. Optics and Precision Engineering, 2019, 27(6): 1370-1377. (in Chinese) doi: 10.3788/OPE.20192706.1370 [8] 常胜江, 孟春宁, 韩建民, 等. 人眼检测技术研究进展[J]. 数据采集与处理,2015,30(6):1131-1146.CHANG SH J, MENG CH N, HAN J M, et al. Survey of eye detection[J]. Journal of Data Acquisition &Processing, 2015, 30(6): 1131-1146. (in Chinese) [9] LIU P ZH, GUO J M, TSENG S H, et al. Ocular recognition for blinking eyes[J]. IEEE Transactions on Image Processing, 2017, 26(10): 5070-5081. doi: 10.1109/TIP.2017.2713041 [10] WU Y L, YEH C T, HUNG W C, et al. Gaze direction estimation using support vector machine with active appearance model[J]. Multimedia Tools and Applications, 2014, 70(3): 2037-2062. doi: 10.1007/s11042-012-1220-z [11] 田耘, 甄雯, 赵海军. 基于改进的SIFT算子和SVM分类器的瞳孔中心定位[J]. 液晶与显示,2017,32(6):499-505. doi: 10.3788/YJYXS20173206.0499TIAN Y, ZHEN W, ZHAO H J. Accurate pupil center location with SIFT descriptor and SVM classifier[J]. Chinese Journal of Liquid Crystals and Displays, 2017, 32(6): 499-505. (in Chinese) doi: 10.3788/YJYXS20173206.0499 [12] MENG CH N, ZHAO X P. Webcam-based eye movement analysis using CNN[J]. IEEE Access, 2017, 5: 19581-19587. doi: 10.1109/ACCESS.2017.2754299 [13] KRUTHIVENTI S S S, AYUSH K, BABU R V. DeepFix: a fully convolutional neural network for predicting human eye fixations[J]. IEEE Transactions on Image Processing, 2017, 26(9): 4446-4456. doi: 10.1109/TIP.2017.2710620 [14] ZHANG X C, SUGANO Y, FRITZ M, et al.. Appearance-based gaze estimation in the wild[C]. 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), IEEE, 2015: 4511-4520. [15] 杨定礼, 张宇林, 周红标, 等. 人眼定位与AdaBoost Gabor滤波的人脸检测算法[J]. 计算机应用研究,2014,31(7):2201-2204. doi: 10.3969/j.issn.1001-3695.2014.07.068YANG D L, ZHANG Y L, ZHOU H B, et al. Face detection based on eye location and AdaBoost Gabor filter[J]. Application Research of Computers, 2014, 31(7): 2201-2204. (in Chinese) doi: 10.3969/j.issn.1001-3695.2014.07.068 [16] WU T H, WANG P, YIN SH N, et al. A dynamical systems novel approach for accurate human eyes location[J]. Journal of Difference Equations and Applications, 2017, 23(1-2): 401-415. doi: 10.1080/10236198.2016.1238469 [17] SHIDNEKOPPA R A, KAMMAR M, SHREEDHAR K S. Liveness detection based on eye flicker[C]. Proceedings of the 3rd International Conference on Cognitive Computing and Information Processing, Springer, 2018: 71-80. [18] VRÂNCEANU R, FLOREA C, FLOREA L, et al. Gaze direction estimation by component separation for recognition of eye accessing cues[J]. Machine Vision and Applications, 2015, 26(2-3): 267-278. doi: 10.1007/s00138-014-0656-8 [19] 孟春宁, 白晋军, 张太宁, 等. 基于梯度积分投影和最大期望算法的人眼定位[J]. 光电子·激光,2012,23(10):1971-1976.MENG CH N, BAI J J, ZHANG T N, et al. Eye localization based on gradient integral projection and expectation-maximization algorithm[J]. Journal of Optoelectronics·Laser, 2012, 23(10): 1971-1976. (in Chinese) [20] CHEN M H, WEN J, ZHU Y, et al.. Multi-level thresholding for pupil location in eye-gaze tracking systerm[C]. 2016 International Conference on Machine Learning and Cybernetics (ICMLC), IEEE, 2016: 1009-1014. [21] 张宏薇, 王仕洋, 李宪龙, 等. 基于Hough变换的瞳孔识别方法研究与实现[J]. 液晶与显示,2016,31(6):621-625. doi: 10.3788/YJYXS20163106.0621ZHANG H W, WANG SH Y, LI X L, et al. Research and implementation of pupil recognition based on Hough transform[J]. Chinese Journal of Liquid Crystals and Displays, 2016, 31(6): 621-625. (in Chinese) doi: 10.3788/YJYXS20163106.0621 [22] ZHAO ZH Q, ZHANG Y, ZHENG Q L. Fast localization algorithm of eye centers based on improved hough transform[C]. 2019 IEEE 7th International Conference on Bioinformatics and Computational Biology (ICBCB), IEEE, 2019: 185-189. [23] SUSITHA N, SUBBAN R. Reliable pupil detection and iris segmentation algorithm based on SPS[J]. Cognitive Systems Research, 2019, 57: 78-84. doi: 10.1016/j.cogsys.2018.09.029 [24] SHANG L, ZHANG C, WU H ZH. Eye focus detection based on OpenCV[C]. 2019 6th International Conference on Systems and Informatics (ICSAI), IEEE, 2019: 855-858. [25] LOY G, ZELINSKY A. Fast radial symmetry for detecting points of interest[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2003, 25(8): 959-973. doi: 10.1109/TPAMI.2003.1217601 [26] YAN B, LI J H, LIU SH, et al.. A robust algorithm for pupil center detection[C]. 2011 6th IEEE Conference on Industrial Electronics and Applications, IEEE, 2011: 413-417. [27] JEONG M, NAM J Y, KO B C. Eye pupil detection system using an ensemble of regression forest and fast radial symmetry transform with a near infrared camera[J]. Infrared Physics &Technology, 2017, 85: 44-51. [28] POULOPOULOS N, PSARAKIS E Z. A new high precision eye center localization technique[C]. 2007 IEEE International Conference on Image Processing (ICIP), IEEE, 2017: 2806-2810. [29] 赵彦涛, 聂向荣, 罗军, 等. 基于选择性阈值取反和径向对称的瞳孔中心定位[J]. 光电子·激光,2016,27(11):1208-1213.ZHAO Y T, NIE X R, LUO J, et al. Pupil center location based on radial symmetry combined with selective threshold[J]. Journal of Optoelectronics·Laser, 2016, 27(11): 1208-1213. (in Chinese) [30] TIMM F, BARTH E. Accurate eye centre localisation by means of gradients[C]. Proceedings of the 6th International Conference on Computer Vision Theory and Applications, VISAPP, 2011: 125-130. -

下载:

下载: