-

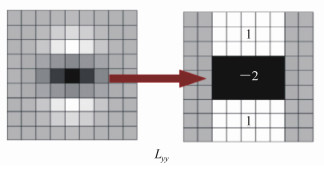

摘要: 为了提高加速鲁棒特征(SURF)算法的实时性和准确性,本文提出了一种结合AGAST角点检测和改进的SURF特征描绘算法。首先利用AGAST角点检测模板检测特征点,再使用增加对角信息的哈尔小波响应来生成特征点的描述子,之后利用特征袋对产生的描述子进行编码并生成新的特征向量,最后利用支持向量机(SVM)对特征向量进行分类,完成识别。本文以SIFT和SURF算法为对照,分别进行不同视角、光照和尺度的识别实验。实验结果表明,本文算法的平均识别率为98.0%、96.9%、97.1%,平均时间分别为66.1 ms、79.3 ms、41.0 ms,在识别率上较优于SURF算法,所耗时间约是SURF算法的1/3。Abstract: To improve the real-time performance and the accuracy of the SURF algorithm, an algorithm combined with AGAST corner detector and improved SURF feature descriptor is proposed. Firstly, feature points are detected by using AGAST corner detection template. Secondly, the Haar wavelet response with increased diagonal information is used to generate descriptor of feature points. Then, the generated descriptor is encoded by the feature bag and a new feature vector is generated. At last, the classification is fulfilled by Support Vector Machine(SVM). Finally, SVM is used to classify the feature vectors to complete the detection. Detection experiments for different view-points, illumination and scales are conducted respectively using SIFT and SURF algorithm as a control. The results show that the average detection rate of this algorithm is 98.0%, 96.9% and 97.1%, and the average time is 66.1 ms, 79.3 ms and 41.0 ms, respectively, which is better than that of SURF algorithm, and the time consumption is about 1/3 of the SURF algorithm.

-

Key words:

- image processing /

- object detection /

- Speeded-Up Robust Features /

- AGAST corner detection

-

表 1 不同视角下3种算法的性能比较

Table 1. Performances comparison of three algorithms under different view-points

SIFT SURF 本文算法 正确数 102 99 100 正确率/% 100 97.0 98.0 平均时间/ms 568.7 287.2 66.1 表 2 不同光照下3种算法的性能比较

Table 2. Performances comparison of three algorithms under different illumination

SIFT SURF 本文算法 正确数 38 47 47 正确率/% 77.6 95.9 95.9 平均时间/ms 590.6 272.9 79.3 表 3 不同尺度下3种算法的性能比较

Table 3. Performances comparison of three algorithms under different scales

SIFT SURF 本文算法 正确数 98 96 98 正确率/% 96.1 94.1 96.1 平均时间/ms 294.1 146.2 41.0 -

[1] 贾平, 徐宁, 张叶.基于局部特征提取的目标自动识别[J].光学 精密工程, 2013, 21(7):1898-1905. http://kns.cnki.net/KCMS/detail/detail.aspx?filename=gxjm201307035&dbname=CJFD&dbcode=CJFQJIA P, XU N, ZHANG Y. Automatic target recognition based on local feature extraction[J]. Opt. Precision Eng., 2013, 21(7):1898-1905.(in Chinese) http://kns.cnki.net/KCMS/detail/detail.aspx?filename=gxjm201307035&dbname=CJFD&dbcode=CJFQ [2] 赵春阳, 赵怀慈.多模态鲁棒的局部特征描述符[J].光学 精密工程, 2015, 23(5):1474-1483. http://kns.cnki.net/KCMS/detail/detail.aspx?filename=gxjm201505035&dbname=CJFD&dbcode=CJFQZHAO CH Y, ZHAO H C. Multimodality robust local feature descriptors[J]. Opt. Precision Eng., 2015, 23(5):1474-1483.(in Chinse) http://kns.cnki.net/KCMS/detail/detail.aspx?filename=gxjm201505035&dbname=CJFD&dbcode=CJFQ [3] LOWE D. Distinctive image features from scale-invariant keypoints[J]. International J. Computer Vision, 2004, 60(2):91-110. doi: 10.1023/B:VISI.0000029664.99615.94 [4] HARRIS C, STEPHENS M. A combined corner and edge detector[J]. Alvey Vision Conference, 1988(3):147-151. http://ci.nii.ac.jp/naid/10007785664/ [5] BAY H, TUYTELAARS T, VAN GOOL L. SURF:speeded-up robust features[J]. Computer Vision & Image Understanding, 2006, 110(3):404-417. http://www.springerlink.com/index/e580h2k58434p02k.pdf [6] MIKOLAJCZYK K, SCHMID C. A performance evaluation of local descriptors[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2005, 27(10):1615-1630. doi: 10.1109/TPAMI.2005.188 [7] 王飞宇, 邸男, 贾平.结合尺度空间FAST角点检测器和SURF描绘器的图像特征[J].液晶与显示, 2014, 29(4):598-604. http://kns.cnki.net/KCMS/detail/detail.aspx?filename=yjys201404025&dbname=CJFD&dbcode=CJFQWANG F Y, DI N, JIA P. Image features using scale-space FAST corner detector and SURF descriptor[J]. Chinese J. Liquid Crystals and Displays, 2014, 29(4):598-604.(in Chinese) http://kns.cnki.net/KCMS/detail/detail.aspx?filename=yjys201404025&dbname=CJFD&dbcode=CJFQ [8] 成培瑞, 王建立, 王斌, 等.基于多尺度区域对比的显著目标识别[J].中国光学, 2016, 9(1):97-105. http://www.chineseoptics.net.cn/CN/abstract/abstract9392.shtmlCHENG P R, WANG J L, WANG B, et al.. Salient object detection based on multi-scale region contrast[J]. Chinese Optics, 2016, 9(1):97-105.(in Chinese) http://www.chineseoptics.net.cn/CN/abstract/abstract9392.shtml [9] 武治国, 李桂菊.动态目标识别中的实时复杂巡航场景运动检测[J].液晶与显示, 2014, 29(5):844-849. http://kns.cnki.net/KCMS/detail/detail.aspx?filename=yjys201405036&dbname=CJFD&dbcode=CJFQWU ZH G, LI G J. Real-time complex cruise scene detection technology in target recognition[J]. Chinese J. Liquid Crystals and Displays, 2014, 29(5):844-849.(in Chinese) http://kns.cnki.net/KCMS/detail/detail.aspx?filename=yjys201405036&dbname=CJFD&dbcode=CJFQ [10] MAIR E, HAGER G, BURSCHKA D, et al.. Adaptive and generic corner detection based on the accelerated segment test[J]. Computer Vision-ECCV, 2010, 2010:183-196. doi: 10.1007/978-3-642-15552-9_14 [11] 王丽.融合底层和中层字典特征的行人重识别[J].中国光学, 2016, 9(5):540-546. http://www.chineseoptics.net.cn/CN/abstract/abstract9441.shtmlWANG L. Pedestrian re-identification based on fusing low-level and mid-level features[J]. Chinese Optics, 2016, 9(5):540-546.(in Chinese) http://www.chineseoptics.net.cn/CN/abstract/abstract9441.shtml [12] ZHANG H, HU Q. Fast image matching based-on improved SURF algorithm[C]. International Conference on Electronics, Communications and Automation Control, IEEE, 2011:1460-1463. [13] ROSTEN E, PORTER R B, DRUMMOND T, et al.. Faster and better:a machine learning approach to corner detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2010, 32(1):105-119. doi: 10.1109/TPAMI.2008.275 [14] CSURKA G, DANCE C, FAN L, et al.. Visual categorization with bags of keypoints[C]. 8th European Conference on Computer Vision, Progue, Czech Republic, 2004:1-22. [15] DONGHOON K, ROZENN D. Face components detection using SURF descriptors and SVMs[C]. IEEE International Machine Vision and Image Processing Conference, IEEE, 2008:51-56. -

下载:

下载: